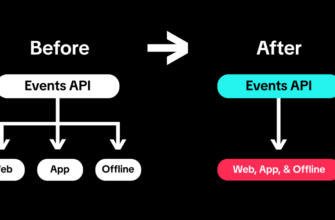

Meta Conversions API давно перестал быть просто “дополнением к пикселю”. Для многих команд это уже основной серверный слой передачи событий, который помогает сохранить стабильность аналитики при ограничениях браузеров, блокировщиках и нестабильной клиентской среде. Но как только CAPI настраивают без системного контроля, появляются две типовые проблемы: дубли событий и просадка качества матчинга.

В актуальной документации Meta для разработчиков на этом сделан прямой акцент. Во-первых, серверные и браузерные события нужно дедуплицировать, если они описывают одно и то же действие пользователя. Во-вторых, customer information parameters нужно передавать осознанно и последовательно, иначе даже корректно отправленное событие может плохо матчиться с аудиторией. На практике это означает, что “просто отправить POST-запрос” недостаточно.

- Зачем вообще нужна deduplication

- Почему проблемы начинаются не в API, а в архитектуре

- Какие параметры клиента влияют на качество матчинга

- Как выстроить безопасную схему deduplication

- 1. Определи единый источник event_id

- 2. Следи за тем, чтобы event_name совпадал полностью

- 3. Проверяй окна времени и фактическую логику отправки

- Где чаще всего ломается качество событий

- Практический чек-лист перед запуском

- Что даёт правильно настроенный CAPI

- Вывод

Зачем вообще нужна deduplication

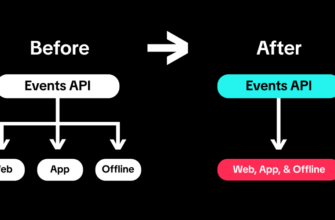

Когда у проекта одновременно работают Pixel и Conversions API, Meta может получить два сигнала об одном и том же действии: браузерный и серверный. Если не настроить deduplication, система может трактовать их как две отдельные конверсии. Это бьёт сразу по нескольким зонам: отчёты искажаются, оптимизация начинает опираться на завышенное число событий, а сравнение с CRM или трекером становится менее надёжным.

Meta рекомендует дедуплицировать такие события через связку event_name и event_id. Логика здесь простая: одно и то же пользовательское действие должно получать одинаковый идентификатор и одинаковое имя события на стороне браузера и сервера. Тогда платформа понимает, что это не две разные покупки, а две версии одного сигнала.

Почему проблемы начинаются не в API, а в архитектуре

Большинство дублей появляются не потому, что Meta “плохо считает”, а потому, что в связке отсутствует единый контракт события. Одна часть команды генерирует event_id в браузере, другая — на сервере, третья вообще не передаёт его стабильно. В результате Pixel и CAPI вроде бы отправляют похожие события, но Meta не может связать их между собой.

Именно поэтому Conversions API лучше строить как часть общей аналитической архитектуры. Если у тебя уже есть трекер и серверная логика, полезно держать рядом материал про Keitaro и Facebook Conversions API, чтобы серверные события в Meta не жили отдельно от остальной системы атрибуции.

Какие параметры клиента влияют на качество матчинга

- Электронная почта, телефон и другие идентификаторы пользователя в хешированном виде, если они легально и корректно доступны.

- IP-адрес и user agent в тех сценариях, где это предусмотрено архитектурой и политикой обработки данных.

- Внешние идентификаторы и служебные поля, если они помогают стабильнее сопоставлять событие с пользователем.

- Единая логика нормализации данных до отправки: формат телефона, очистка email и последовательная подготовка входных значений.

Из документации Meta следует важный практический вывод: качество матчинга зависит не только от количества параметров, но и от качества их подготовки. Если телефон передаётся в случайном формате, email содержит лишние пробелы, а часть событий приходит без минимального набора полей, улучшения от CAPI будут ограниченными даже при “формально рабочей” интеграции.

Как выстроить безопасную схему deduplication

1. Определи единый источник event_id

Нужно заранее решить, где именно рождается идентификатор события. Удобнее всего, когда он создаётся один раз и затем используется обеими сторонами: и Pixel, и сервером. Тогда у системы нет повода воспринимать сигналы как независимые.

2. Следи за тем, чтобы event_name совпадал полностью

Если браузер отправляет Purchase, а сервер — purchase или внутреннее имя, deduplication может не сработать так, как ожидается. Название события должно быть единым.

3. Проверяй окна времени и фактическую логику отправки

Даже при корректном event_id система будет работать хуже, если один сигнал уходит почти мгновенно, а второй с большим и непредсказуемым лагом из-за очередей или ручной обработки. Поэтому CAPI надо не просто “включить”, а реально протестировать на живой цепочке.

Где чаще всего ломается качество событий

Первая слабая зона — неочищенные customer information parameters. Вторая — отсутствие единообразия между браузерным и серверным слоем. Третья — отсутствие сверки с реальной аналитикой проекта. Если в Meta всё выглядит красиво, а трекер и CRM показывают другую картину, проблему надо искать в архитектуре, а не в интерфейсе Ads Manager.

В этом месте особенно важна внутренняя дисциплина параметров. Если сама связка трекинга собрана с перекосами, Conversions API только унаследует эти ошибки. Поэтому вместе с CAPI логично держать в порядке и структуру трекинга в Keitaro.

Практический чек-лист перед запуском

- Проверь, что для одного пользовательского действия Pixel и сервер используют одинаковые

event_nameиevent_id. - Убедись, что customer information parameters очищаются и нормализуются до отправки.

- Сравни событие в Meta с данными трекера, CRM или внутренней системы.

- Сделай серию тестовых действий и проверь, нет ли дублей в отчётах.

- Оставь короткий внутренний документ по формированию событий, чтобы интеграцию не сломали следующими правками.

Что даёт правильно настроенный CAPI

Если deduplication и параметры клиента настроены аккуратно, Meta получает более устойчивый серверный сигнал, а команда — более надёжную базу для оптимизации. Это не магический “буст” результативности, а инженерная дисциплина вокруг данных. Но именно она помогает не терять качество аналитики по мере роста объёма трафика.

Для white-hat проектов это особенно важно: чем прозрачнее и чище архитектура событий, тем легче сопоставить рекламные данные, трекинг и фактические результаты. Серверная передача должна усиливать систему, а не создавать новый источник искажений.

Вывод

Meta Conversions API работает лучше всего тогда, когда настроен как часть общей аналитической схемы. Deduplication через единые event_name и event_id, корректная подготовка customer information parameters и регулярная сверка с трекером позволяют избежать и дублей, и потерь качества. Для зрелой закупки трафика это уже не дополнительная опция, а базовая гигиена данных.